模型编辑 - 附加参数法

概述

附加参数法在模型中引入额外的参数,并对这部分参数进行训练以实现特定知识的编辑。其在准确性、泛化性、可迁移性等方面均取得良好的表现。

T-Patcher

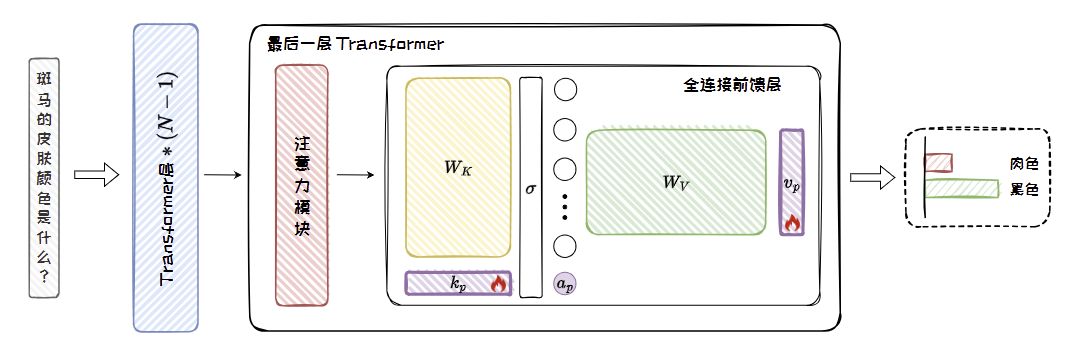

T-Patcher是附加参数法中的代表性方法,其在模型最后一个Transformer 层的全连接前馈层中添加额外参数(称为“补丁”),然后对补丁进行训练来完成特定知识的编辑,如图。T-Patcher 可以在不改变原始模型整体架构的情况下,对模型进行编辑。

补丁的位置

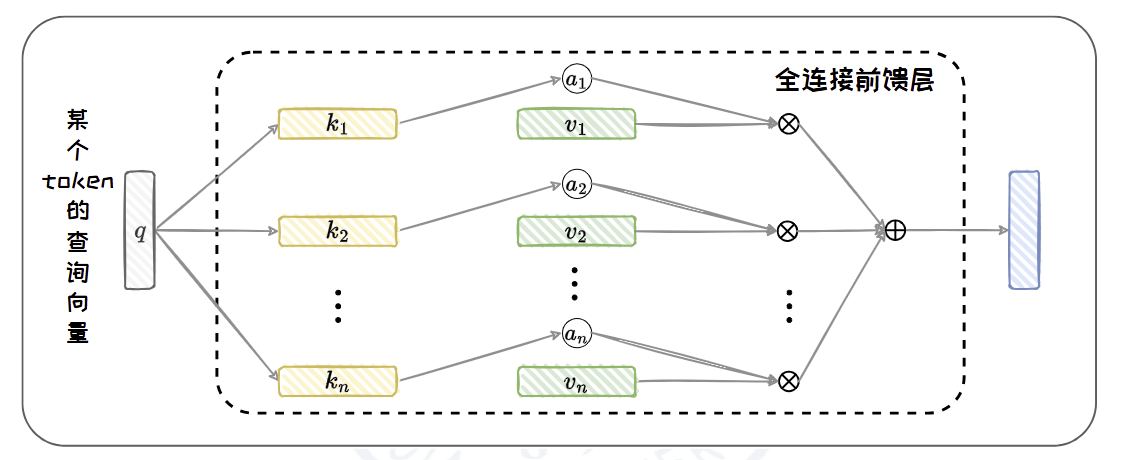

将补丁添加在模型中的不同位置会影响模型编辑的效果。T-Patcher 将全连接前馈层视为键值存储体,如图。并选择在最后一个Transformer 层的全连接前馈层中添加补丁参数。在这种设计中,添加补丁相当于向键值存储体中增加新的记忆单元,通过精确控制补丁的激活,T-Patcher 能够针对特定输入进行修正,并减少对无关输入的影响。

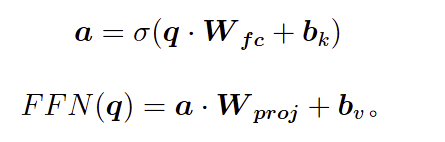

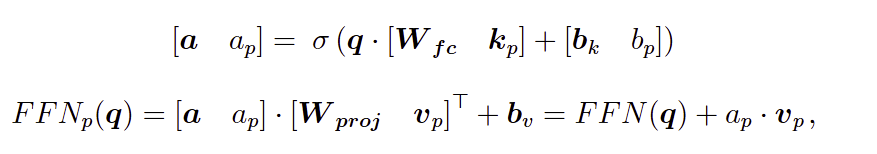

键值存储体包含键向量矩阵Wfc= [k1, k2, . . . , kn] 及其偏置向量bk、激活函数σ 和值向量矩阵Wproj = [v1, v2, . . . , vn] 及其偏置向量bv。

补丁的形式

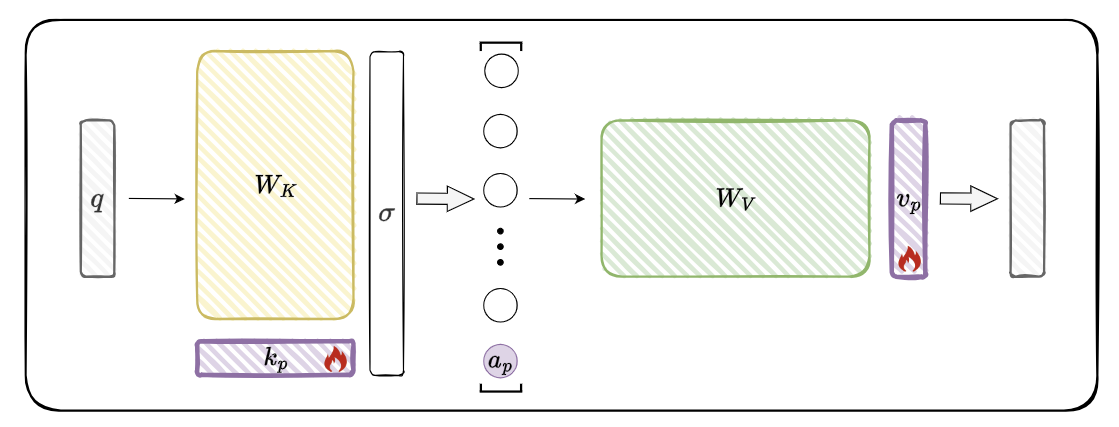

T-Patcher 在全连接前馈层中加入额外的键值对向量作为补丁,通过训练补丁参数从而实现模型编辑。补丁的形式如图所示,它主要包括一个键向量kp、一个值向量vp 和一个偏置项bp。

在添加补丁后,全连接前馈层的输出被调整为:

补丁的实现

在确定了补丁的位置和形式之后,下一步便是训练补丁以实现模型编辑。对于给定的编辑问题,T-Patcher 为每个需要编辑的Token 都添加一个补丁,从而可以精确地针对每个编辑需求进行调整。最后,T-Patcher 从编辑的准确性和局部性两个角度出发对损失函数进行设计。

- 准确性

- 确保补丁可以在目标输入下可以被激活;

- 一旦被激活,补丁应该能够准确地调整模型输出以符合预期的结果。

- 局部性

- 模型编辑不仅要确保精确的编辑,而且要求在对目标问题进行编辑时,不应影响模型在其他无关问题上的表现。