模型编辑 - 方法

概述

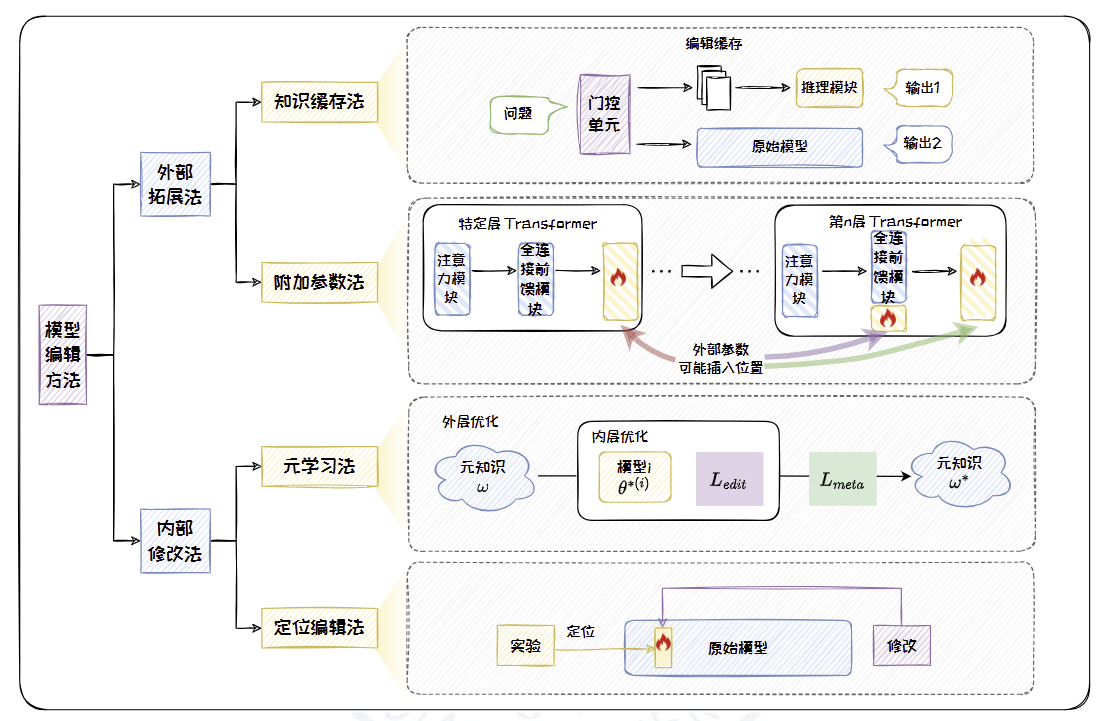

现有编辑方法分为外部拓展法和内部修改法。

- 外部拓展法

- 思想:通过设计特定的训练程序,使模型在保持原有知识的同时学习新信息。

- 常见方法:包括知识缓存法和附加参数法

- 内部修改

- 思想:通过调整模型内部特定层或神经元,来实现对模型输出的精确控制。

- 常见方法:包括元学习法和定位编辑法

外部拓展法

核心思想是将新知识存储在附加的外部参数或外部知识库中,将其和原始模型一起作为编辑后模型。

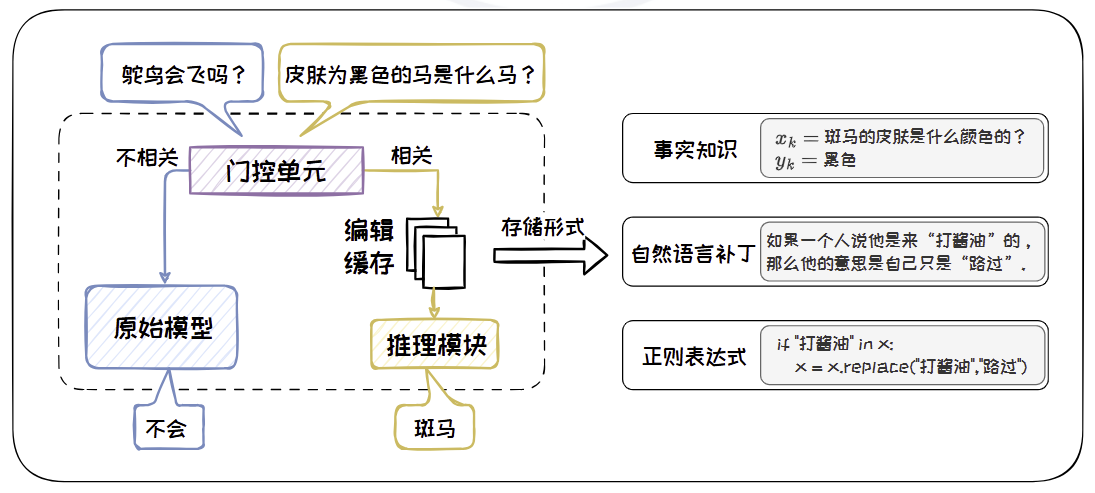

知识缓存法

知识缓存法中包括三个主要组件,分别为门控单元、编辑缓存和推理模块。

- 门控单元:用于判断输入问题与编辑缓存中的知识的相关程度,可通过分类或噪声对比估计等任务进行训练。

- 编辑缓存:充当一个知识存储库,用于保存需要修改的知识,这些知识由用户通过不同的形式指定。

- 推理模块:获取原始输入问题和编辑缓存中的知识作为输入,通过监督训练的方式学习预测用户期望的结果。

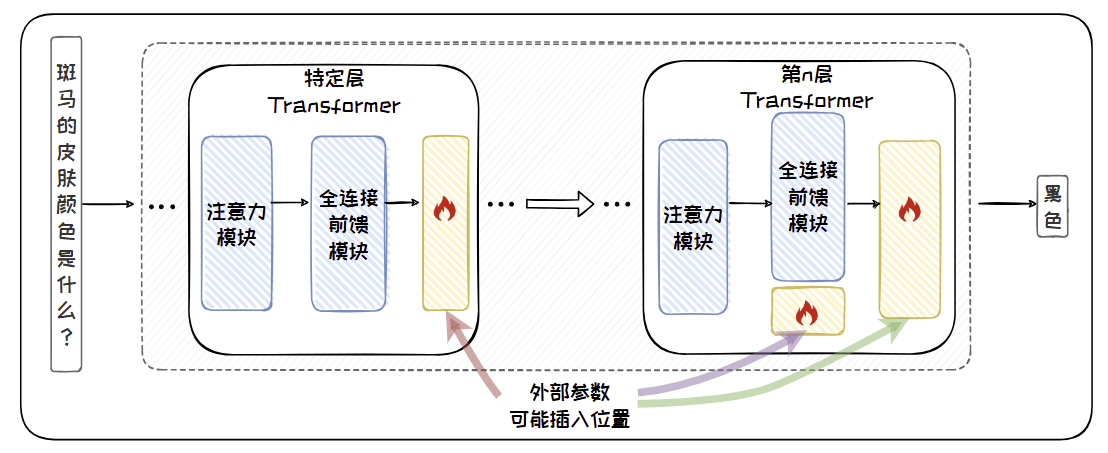

附加参数法

附加参数法可以将外部参数整合进模型结构,从而有效利用和扩展模型的功能。

这类方法的思想与参数高效微调中的参数附加方法类似,都是将外部参数插入到模型中的特定位置,冻结原始模型,只训练新引入的参数以修正模型输出。

内部修改法

内部修改法旨在通过更新原始模型的内部参数来为模型注入新知识,能够优化模型的自我学习和适应能力,提高其在特定任务上的表现,而不是仅仅停留在表面的知识积累。

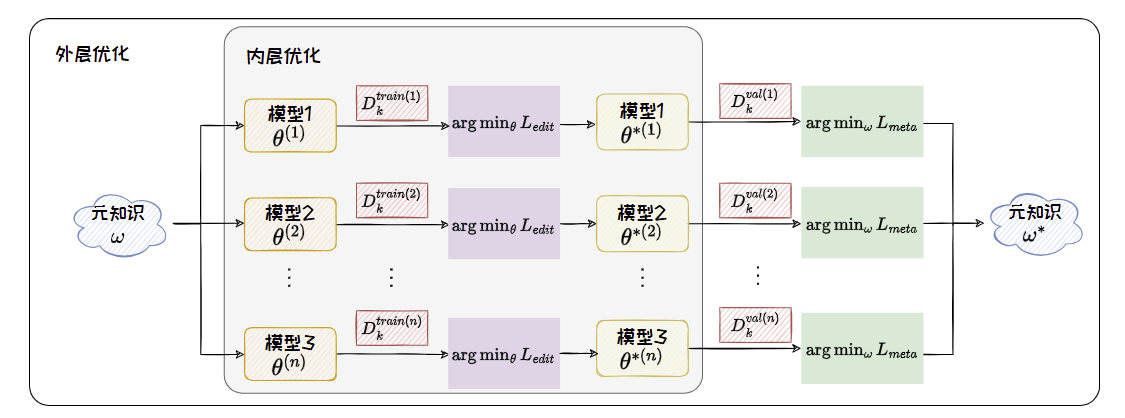

元学习法

元学习指的是模型“学习如何学习”(Learning to Learn)的过程。

核心思想是使模型从一系列编辑任务中提取通用的知识,并将其应用于未见过的编辑任务,这部分知识被称为元知识ω。

元训练过程可以看作一个双层优化问题: 内层优化是模型在不同编辑任务上的优化,外层优化是元知识在验证集中的编辑任务上的综合优化。

定位编辑法

定位编辑法修改的是原始模型的局部参数。其先定位到需要修改的参数的位置,然后对该处的参数进行修改。