样式迁移

“样式迁移”(Style Transfer)是一种深度学习技术,主要用于将一幅图像的风格迁移到另一幅内容图像上,同时保留原内容的结构和语义信息。这项技术在艺术创作、图像处理、摄影滤镜、视频特效等领域有广泛应用。

基本原理

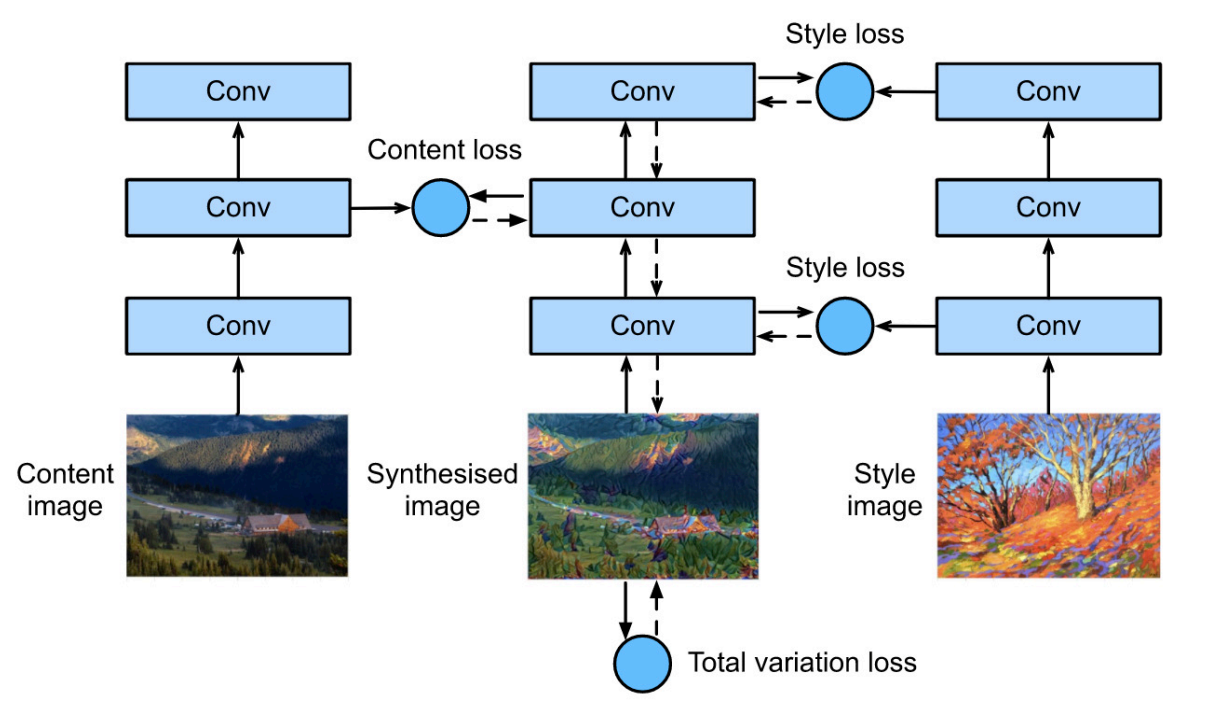

样式迁移的核心思想:利用卷积神经网络(CNN)提取图像的内容特征和风格特征:

- 内容特征:通常来自网络较深层(如VGG19的

conv4_2),反映图像的高层语义结构。 - 风格特征:通过计算多个卷积层(如

conv1_1,conv2_1, ...,conv5_1)的Gram矩阵来捕捉纹理、颜色、笔触等风格信息。

目标是生成一张新图像,使其:

- 内容损失(Content Loss)小 → 与内容图像相似;

- 风格损失(Style Loss)小 → 与风格图像相似。

总损失函数通常为:

\begin{flalign*} \text{其中 } \alpha \text{ 和 } \beta \text{ 是权重超参数。} & \end{flalign*}

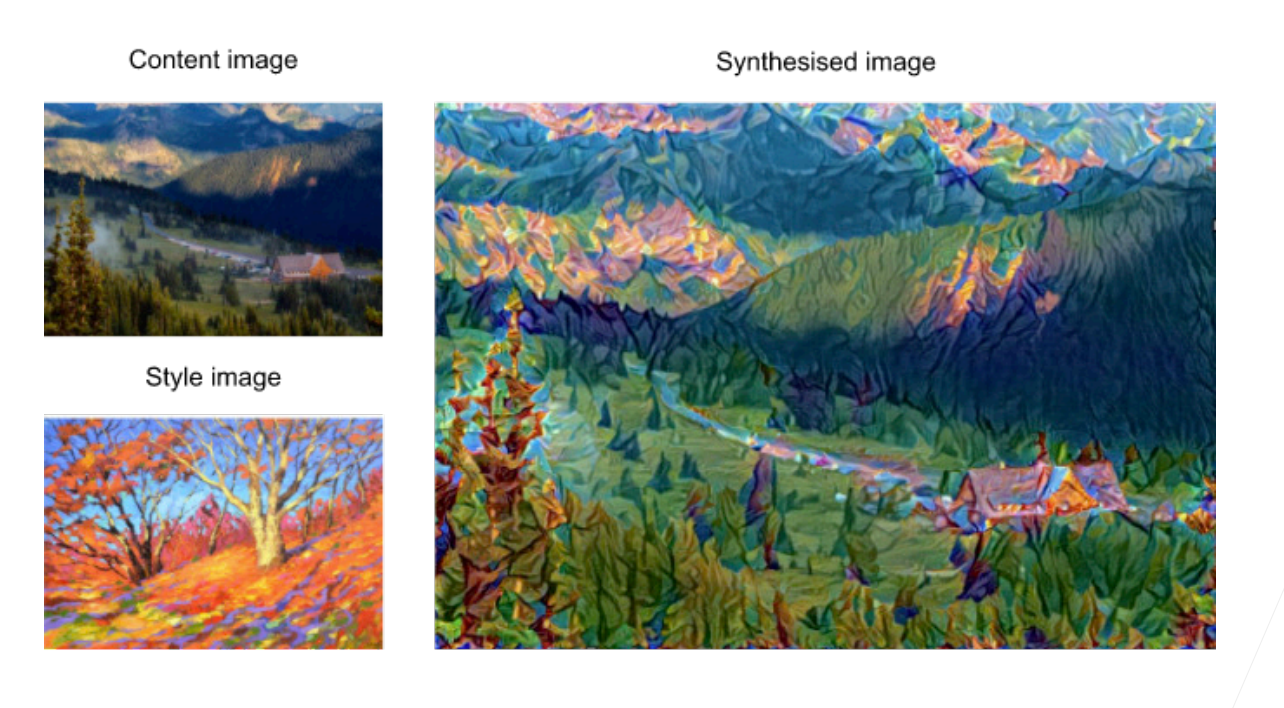

将样式图片中的样式迁移到内容图片上,得到合成图片,过程如下:

具体原理如图所示:

主要方法

基于CNN的样式迁移

优化-based 方法(Gatys et al., 2015)

- 从随机噪声开始,通过梯度下降优化生成图像。

- 优点:灵活,可任意组合内容与风格。

- 缺点:速度慢,每张图需多次迭代。

前馈网络方法(Fast Style Transfer)

- 训练一个前馈神经网络(如U-Net或ResNet变体),直接将内容图像映射为风格化图像。

- 优点:推理速度快(实时)。

- 缺点:每个风格需单独训练一个模型。

AdaIN / Arbitrary Style Transfer

- 如《Arbitrary Style Transfer in Real-time with Adaptive Instance Normalization》(Huang & Belongie, 2017)。

- 使用自适应实例归一化(AdaIN)实现任意风格的实时迁移。

- 只需一个模型即可处理任意风格图像。

基于Transformer的方法

- 近年也有研究将Vision Transformer用于风格迁移,提升全局风格一致性。