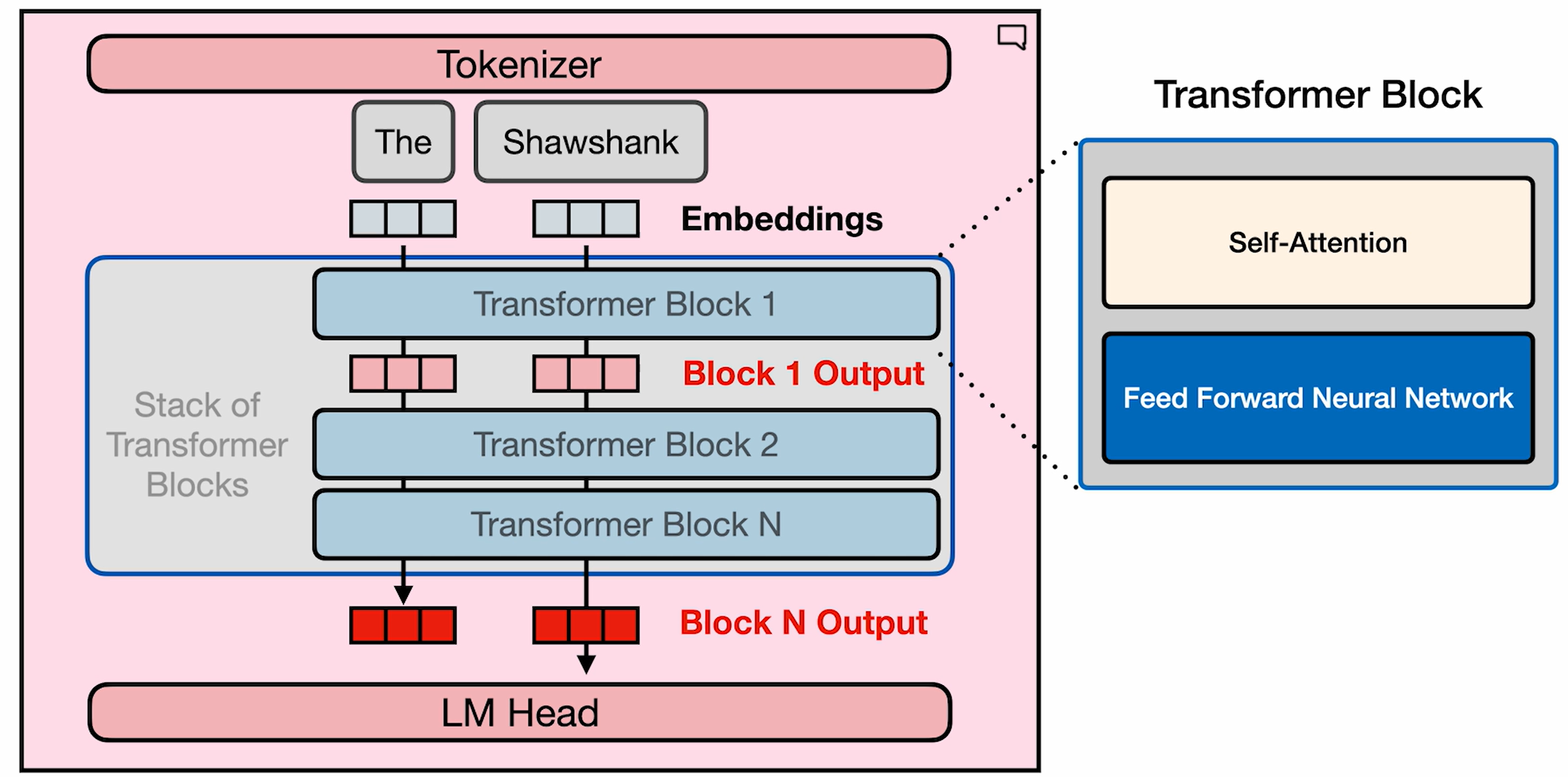

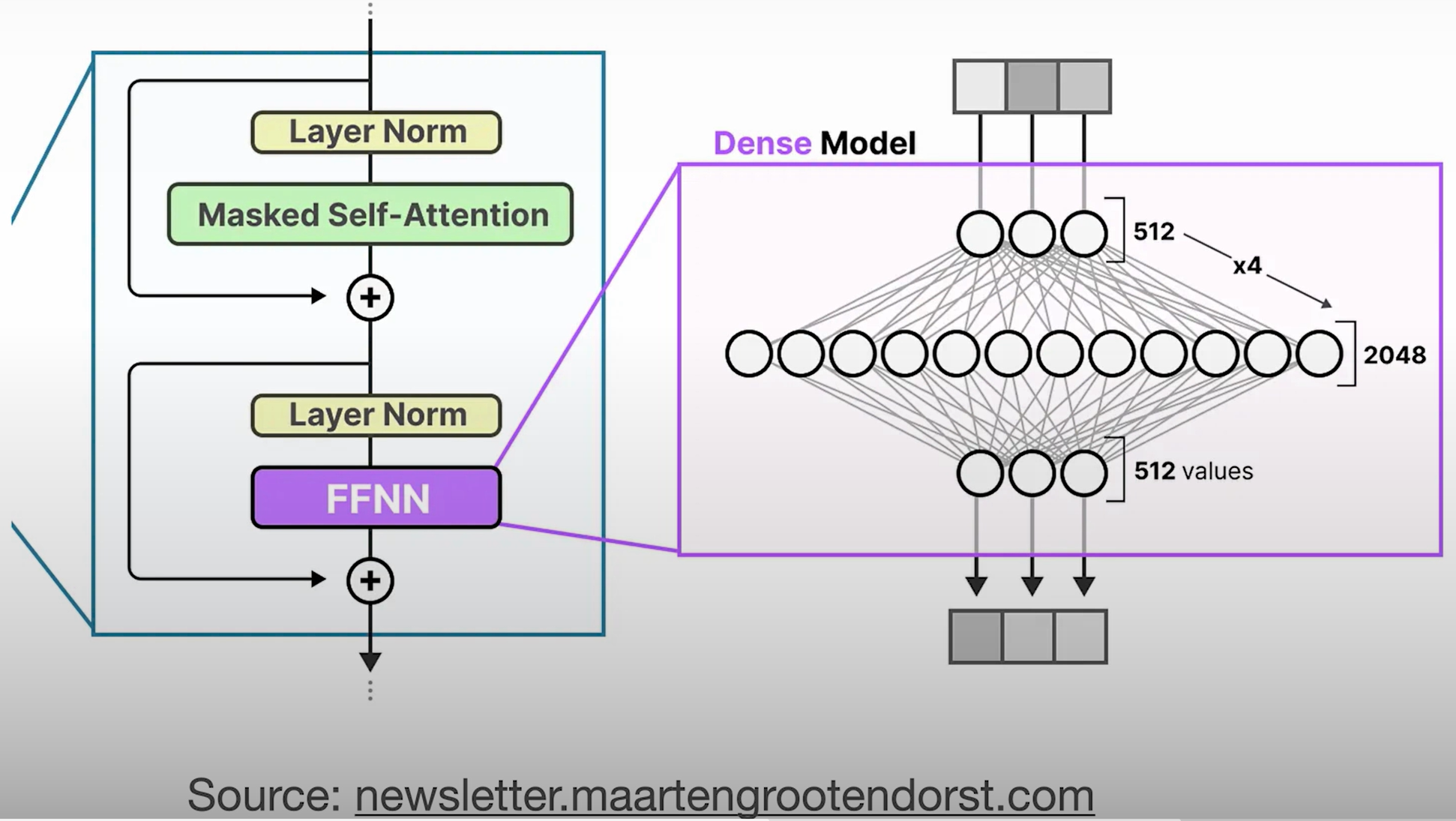

Transformer - Block

Transformer LLM

Transformer Block: Feedforward Neural Network Intuition

- 直觉:

- 存储信息和统计数据

- 在此基础上,它能够预测下一个可能的单词。

- 就肖申克而言,下一个可能的单词将是“救赎”,因为这是一部著名的电影。

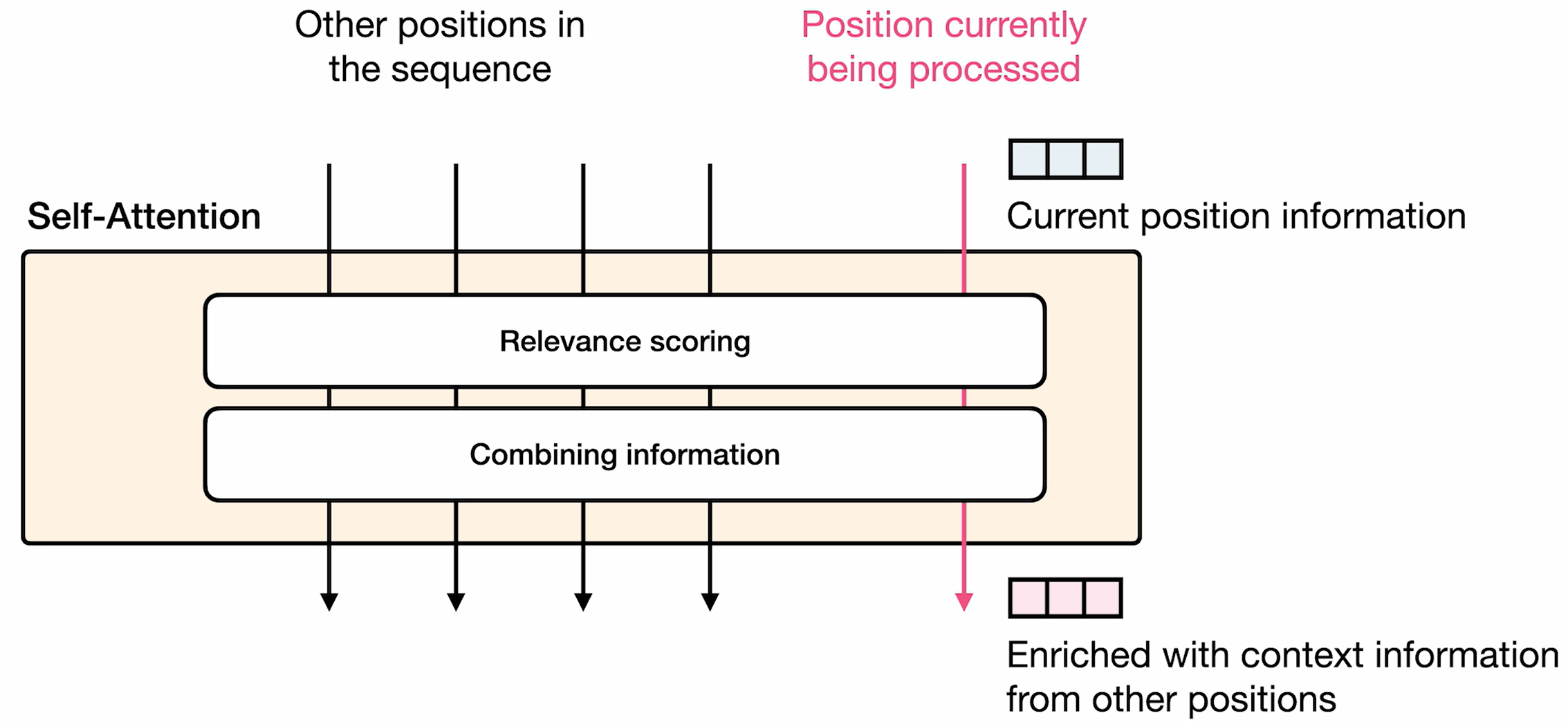

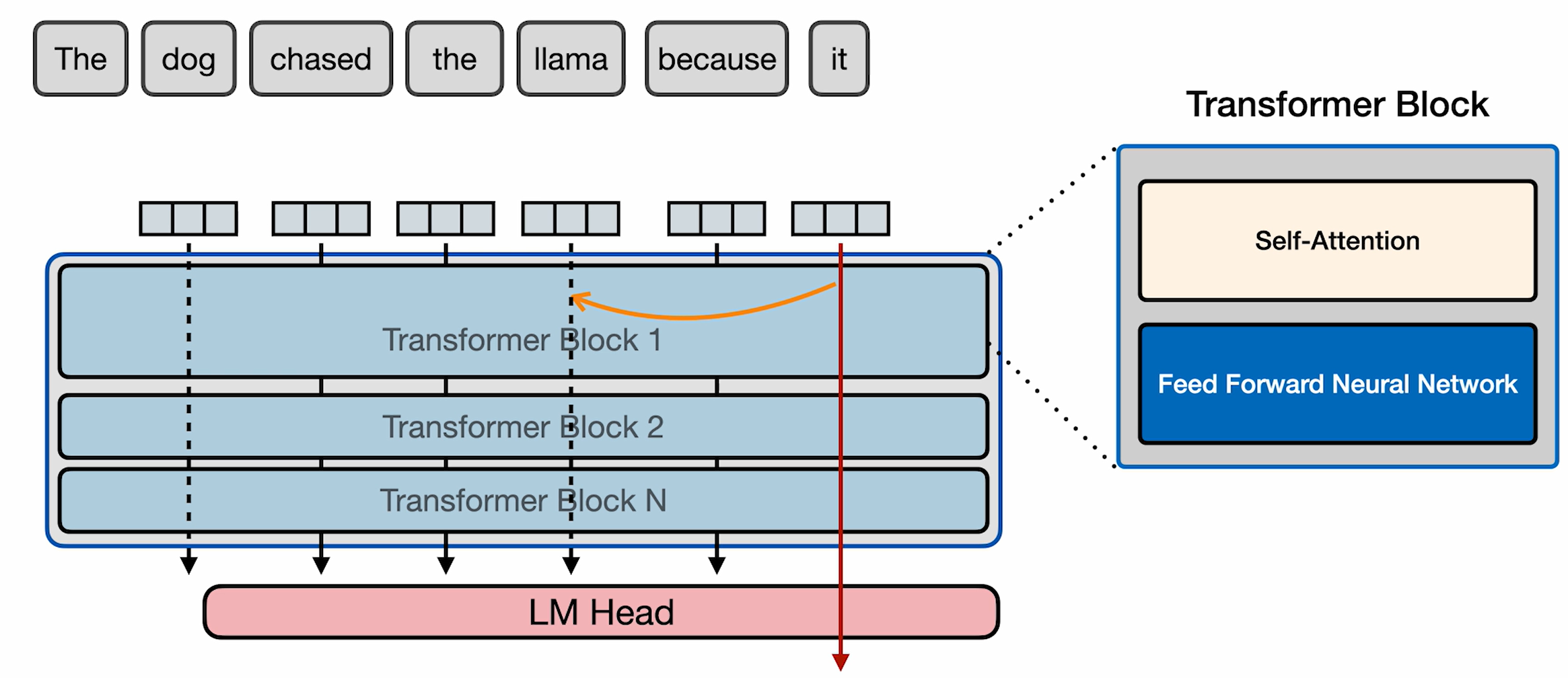

Transformer Block: Self Attention

注意力使我们能够从上下文中整合相关信息

关联解析

自注意力实现

- 相关性评分

- 计算其他标记的上下文相关性

- 组合信息

- 将相关性组合到当前标记的向量表示中