MCP - 架构

MCP的C/S架构

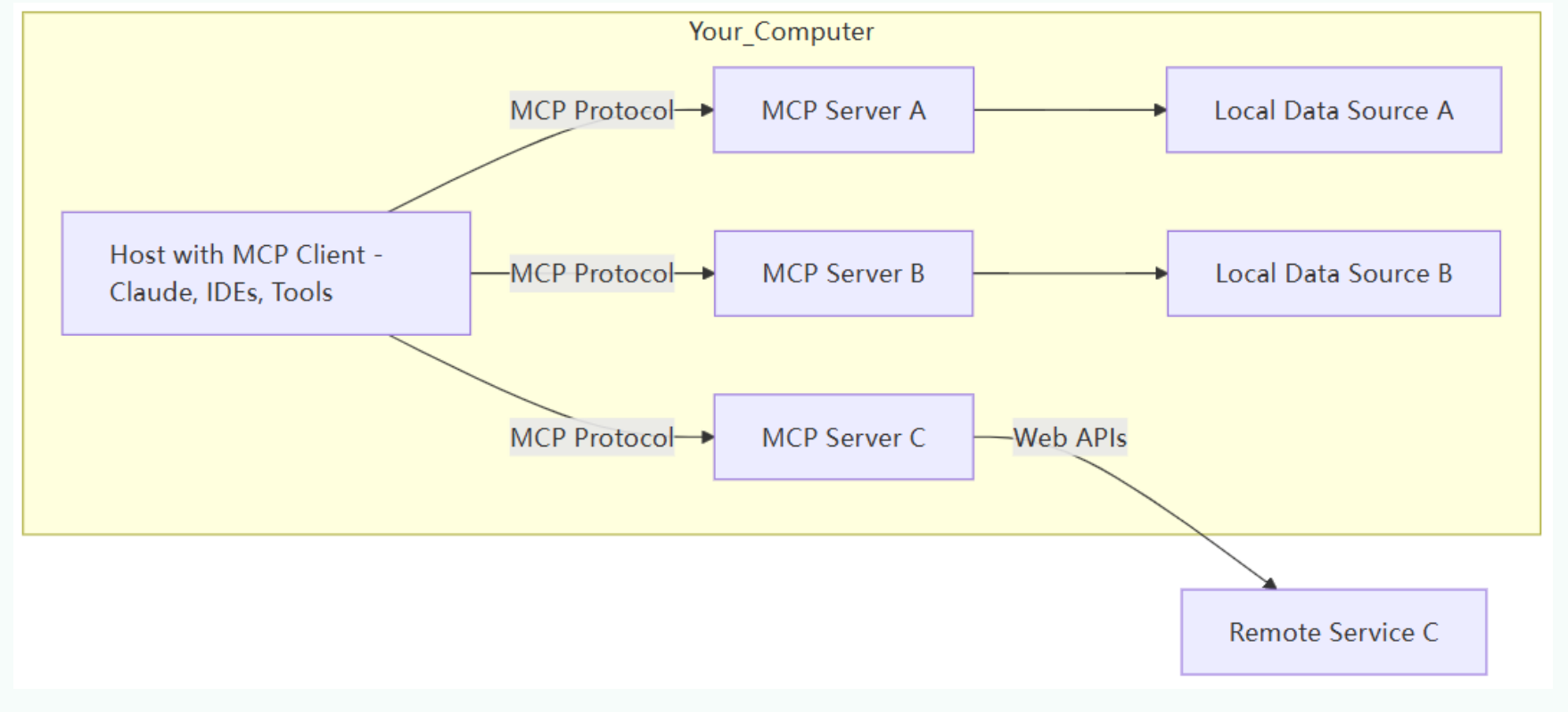

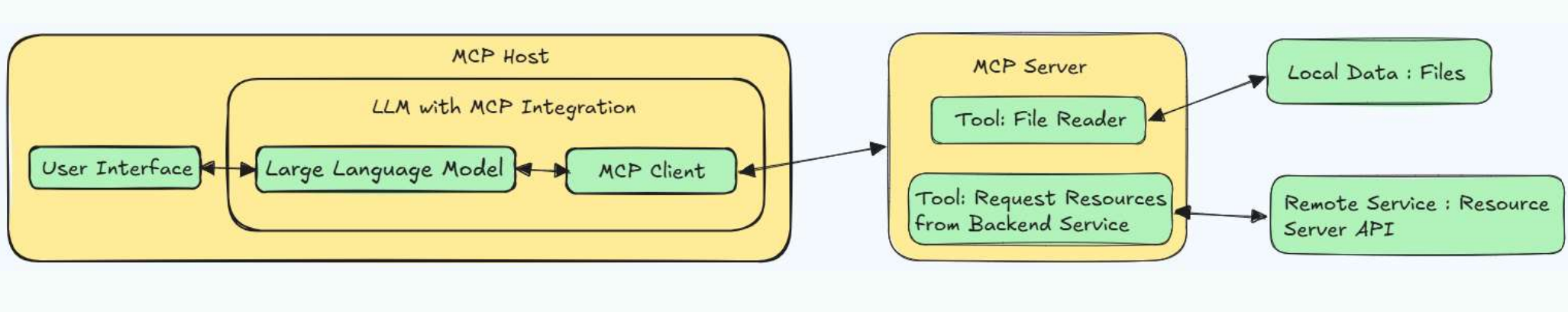

MCP 遵循客户端-服务器架构(client-server),其中包含以下几个核心概念:

- MCP 主机 (MCP Hosts)

- MCP 客户端 (MCP Clients )

- MCP 服务器 (MCP Servers )

- 本地资源 (Local Resources )

- 远程资源 (Remote Resources )

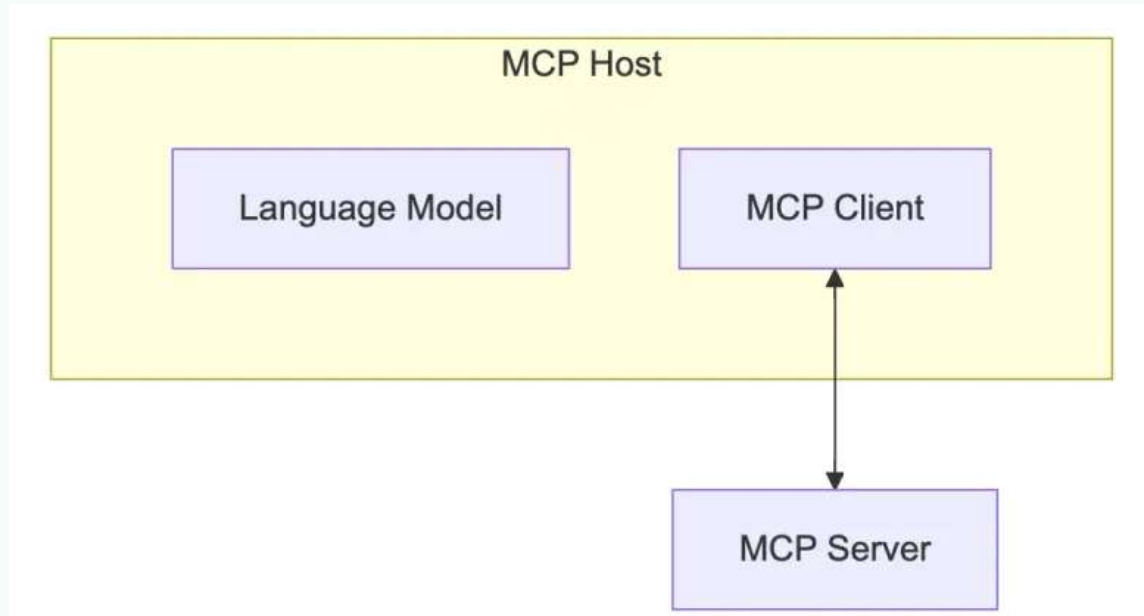

MCP Host

作为运行 MCP 的主应用程序,例如 Claude Desktop、Cursor、Cline 或 AI 工具。为用户提供与LLM交互的接口,同时集成 MCP Client 以连接 MCP Server。

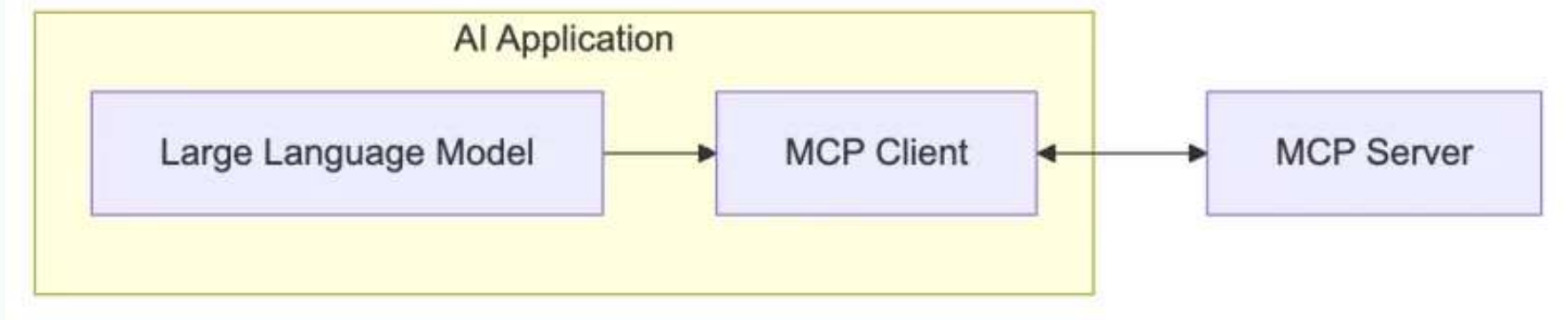

MCP Client

MCP client 充当 LLM 和 MCP server 之间的桥梁,嵌入在主机程序中,主要负责:

- 接收来自LLM的请求;

- 将请求转发到相应的

MCP server - 将

MCP server的结果返回给LLM

MCP 官网(https://modelcontextprotocol.io/clients) 列出来一些支持 MCP 的 Clients。

分为两类:

- AI编程IDE:Cursor、Cline、Continue、Sourcegraph、Windsurf 等

- 聊天客户端:Cherry Studio、Claude、Librechat、Chatwise等

更多的Client参考这里:

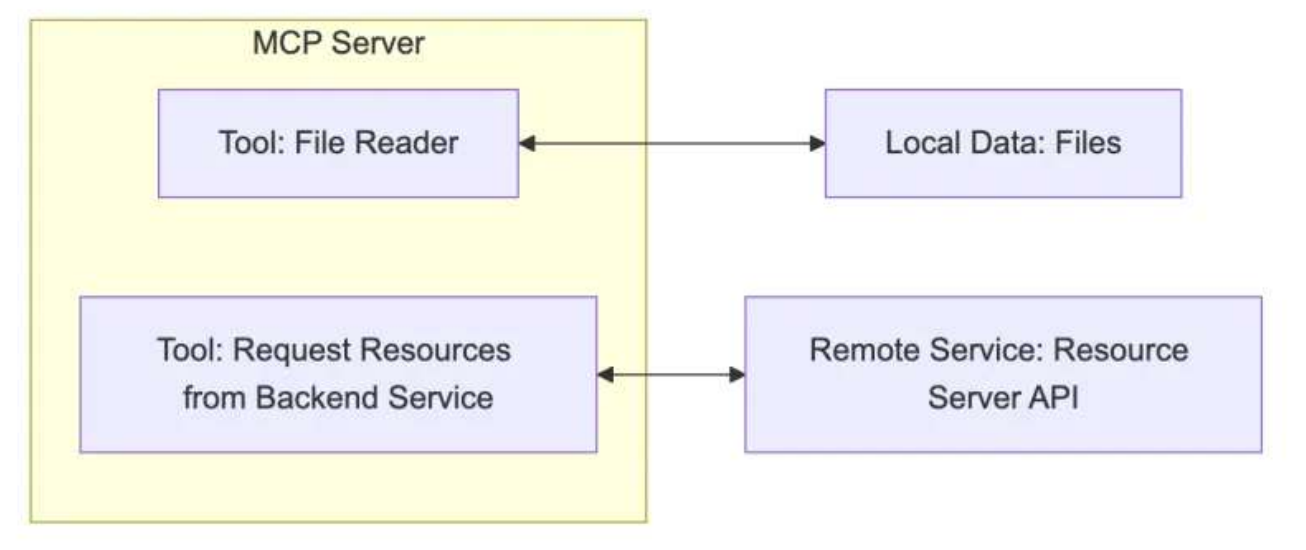

MCP Server

每个 MCP 服务器都提供了一组特定的工具,负责从本地数据或远程服务中检索信息。是 MCP 架构中的关键组件。

与传统的远程 API 服务器不同,MCP 服务器既可以作为本地应用程序(stdio方式)在用户设备上运行,也可部署至远程服务器(SSE方式)。

本质是运行在电脑上的一个nodejs或python程序。可以理解为客户端用命令行调用了电脑上的nodejs或python程序。

- 使用 TypeScript 编写的 MCP server 可以通过 npx 命令来运行

- 使用 Python 编写的 MCP server 可以通过 uvx 命令来运行。

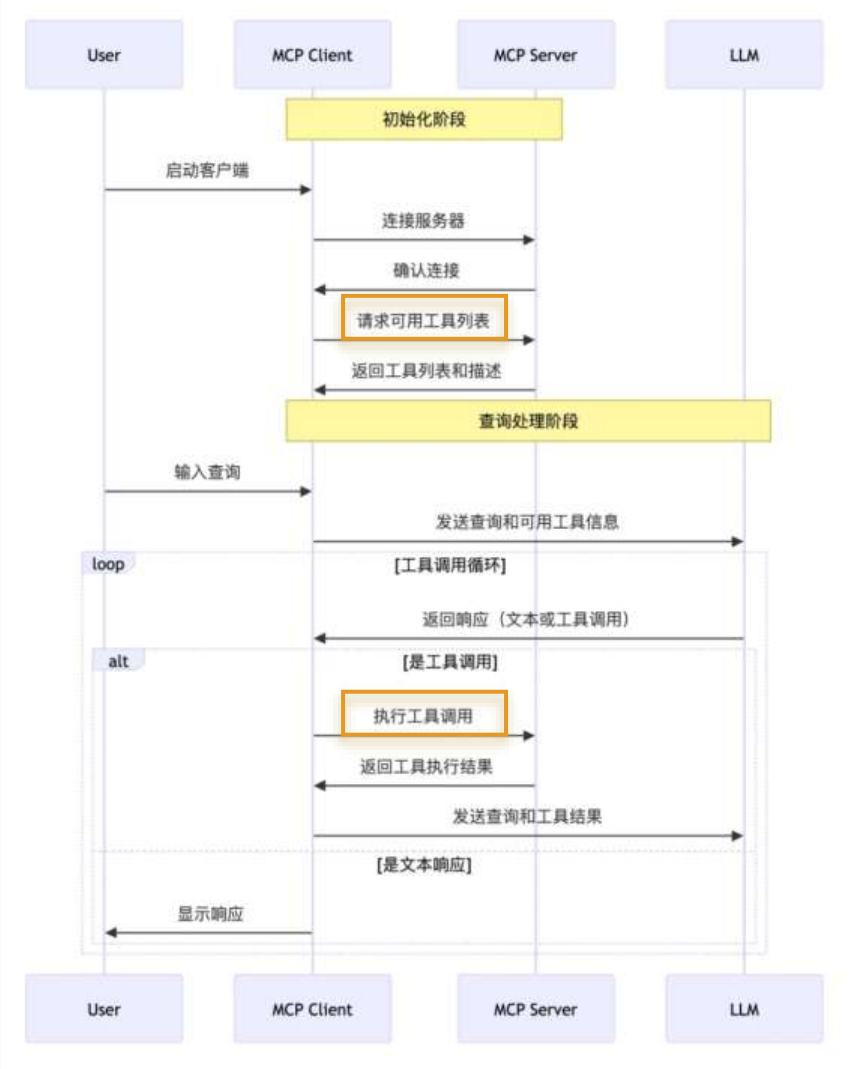

MCP工作流程

API 主要有两个:

- tools/list:列出 Server 支持的所有工具

- tools/call:Client 请求 Server 去执行某个工具,并将结果返回