神经网络 - 基础

神经网络(Neural Network)是一种受生物神经系统启发而设计的计算模型,是机器学习和深度学习的核心技术。它通过模拟人脑中神经元之间的连接与信息处理机制,实现对复杂数据(如图像、语音、文本等)的建模和学习。

人脑神经网络

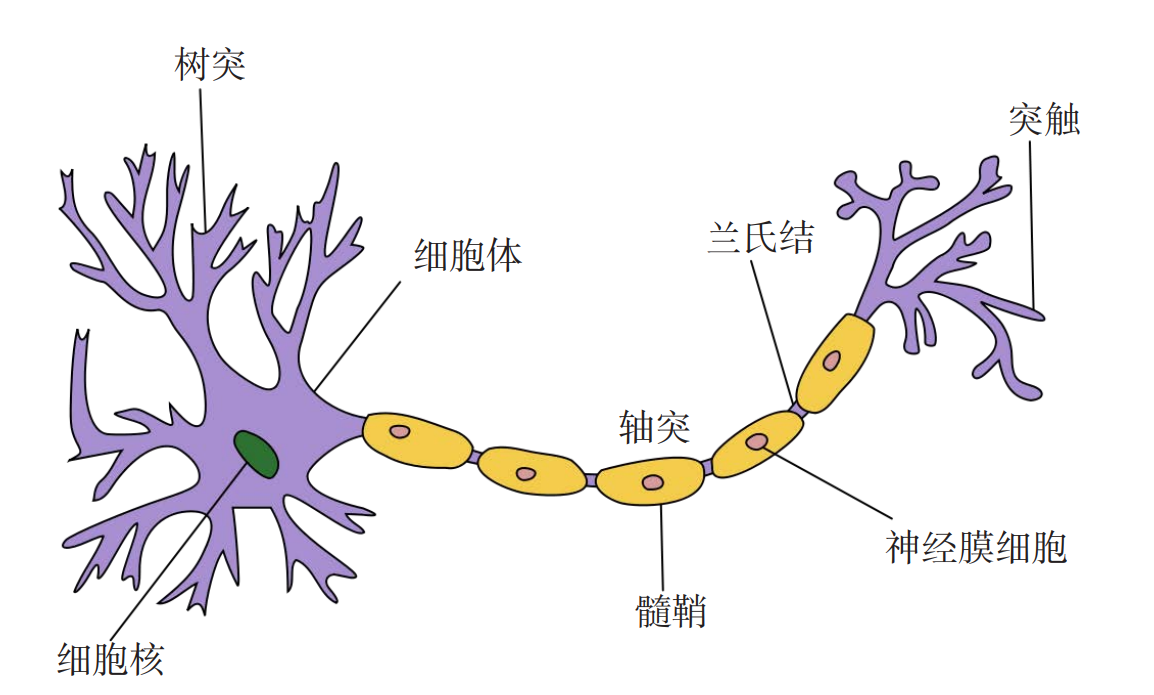

人类大脑是人体最复杂的器官,由神经元、神经胶质细胞、神经干细胞和血管组成。其中,神经元(Neuron)是携带和传输信息的细胞,是人脑神经系统中最基本的单元。人脑神经系统是一个非常复杂的组织,包含近860亿个神经元,每个神经元有上千个突触和其他神经元相连接。这些神经元和它们之间的连接形成巨大的复杂网络。

人工神经网络(Artificial Neural Network,ANN)是指一系列受生物学和神经科学启发的数学模型,它从结构、实现机理和功能上模拟人脑神经网络。人工神经网络与生物神经元类似,由多个节点(人工神经元)互相连接而成,可以用来对数据之间的复杂关系进行建模。不同节点之间的连接被赋予了不同的权重,每个权重代表了一个节点对另一个节点的影响大小。每个节点代表一种特定函数,来自其他节点的信息经过其相应的权重综合计算,输入到一个激活函数中并得到一个新的活性值(兴奋或抑制)。从系统观点看,人工神经元网络是由大量神经元通过极其丰富和完善的连接而构成的自适应非线性动态系统。

核心概念

- 神经元(Neuron)

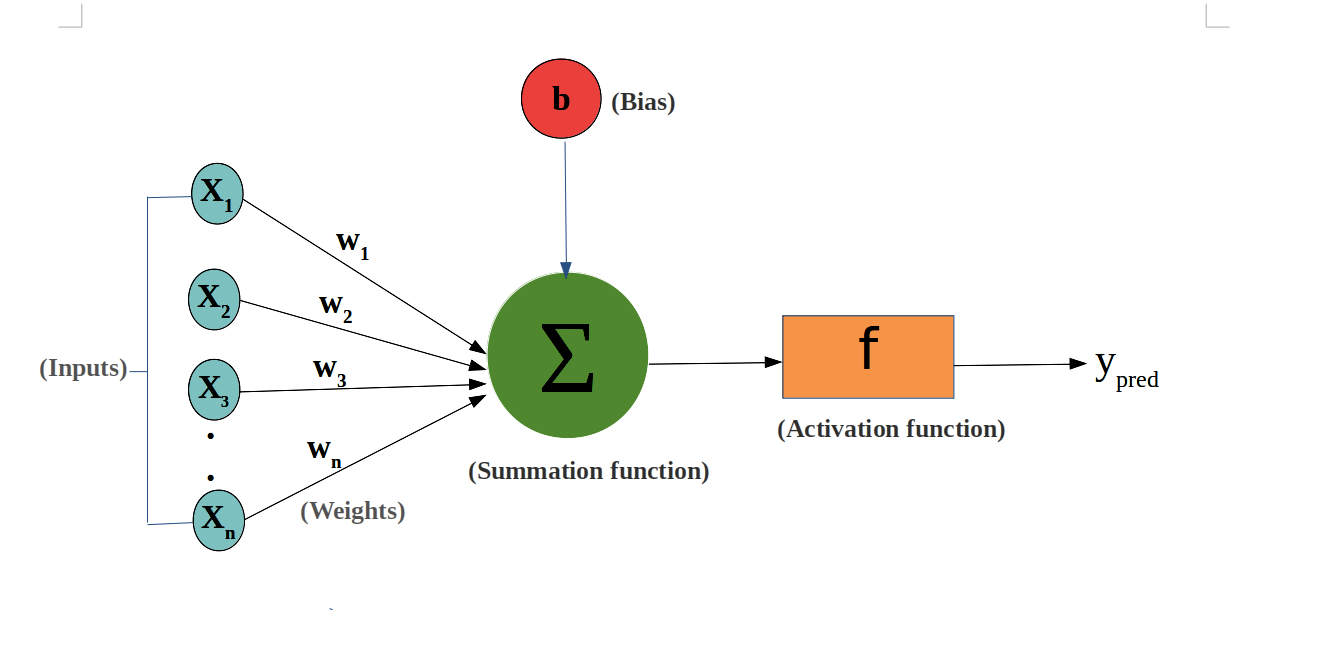

- 神经网络的基本单元,模拟生物神经元。

- 接收输入信号(),加权求和(,其中 是偏置项),再通过激活函数(如ReLU、Sigmoid)输出结果。

- 神经元的权重和偏置是网络学习过程中需要调整的参数。

- 层(Layer)

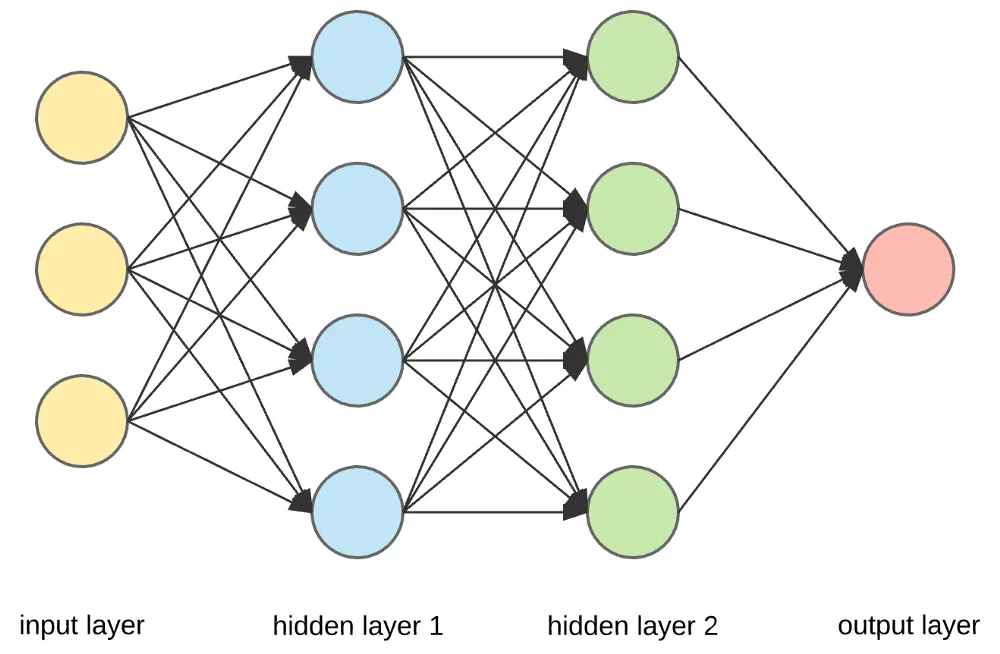

- 输入层(Input Layer):接收原始数据(如像素值、单词向量)。

- 隐藏层(Hidden Layer):介于输入和输出层之间,负责特征提取和转换(深度网络有多层隐藏层)。

- 输出层(Output Layer):生成最终预测(如分类概率、回归值)。

权重(Weights)与偏置(Bias)

- 权重:连接各神经元之间的边具有权重,表示输入信号的重要性。

- 偏置:为神经元提供额外的输入信号,帮助网络学习数据中的复杂模式。

- 通过训练(如反向传播)自动优化这些参数。

激活函数(Activation Function)

- 用于决定神经元是否应该被激活,即其输出是否应传递到下一层。

- 引入非线性,使网络能拟合复杂函数。常见函数:

- Sigmoid:输出0~1,用于二分类。

- ReLU:解决梯度消失问题,加速训练。

- Softmax:多分类输出概率分布。

前向传播(Forward Propagation)

- 数据从输入层逐层计算,最终得到输出结果的过程。

损失函数(Loss Function)

- 衡量预测值与真实值的差异(如交叉熵损失

CrossEntropyLoss、均方误差MSELoss)。 - 目标是通过训练最小化损失。

- 衡量预测值与真实值的差异(如交叉熵损失

反向传播(Backpropagation)

- 根据损失函数计算梯度,从输出层反向调整权重和偏置(使用优化器如SGD、Adam)。

优化器(Optimizer)

- 控制参数更新策略,常见方法:梯度下降(Gradient Descent)、Adam等。

神经网络类型

- 前馈神经网络(Feedforward Neural Networks):数据单向流动,从输入层到输出层,无反馈连接。

- 卷积神经网络(Convolutional Neural Networks, CNNs):适用于图像处理,使用卷积层提取空间特征。

- 循环神经网络(Recurrent Neural Networks, RNNs):适用于序列数据,如时间序列分析和自然语言处理,允许信息反馈循环。

- 长短期记忆网络(Long Short-Term Memory, LSTM):一种特殊的RNN,能够学习长期依赖关系。

- Transformer:基于自注意力机制,擅长长序列建模(如BERT、GPT)。

- 生成对抗网络(GAN):生成与真实数据相似的样本(如生成图像)。